如何正确设置网站的robots.txt文件

作为站长朋友对于网站robots.txt文件都不陌生,其实一个合格的网站,有必要在根目录下包括一下robots.txt文件。

robots.txt是一个简单的以.txt结尾的文本文件,是搜索引擎Robot(也叫搜索引擎机器人)程序抓取网页时要访问的第一个文件。

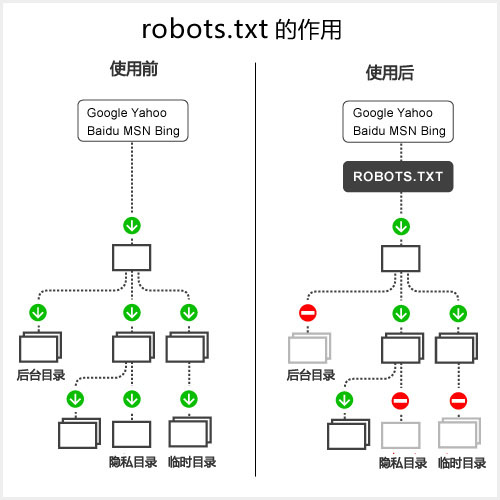

通过robots.txt文件,可以和各大搜索引擎很友好的对话,引导搜索引擎机器人抓取你推荐的网页,避免一些意义不大或无用网页,例如网站后台、会员交互功能等,这在一定程度上也节省服务器网络资源。

另外,robots.txt文件对SEO的意义也很重要,可以很好的避免重复、相似网页,以及一些关键字权重流失。今天笔者就跟大家分享一下如何正确设置网站的robots.txt文件?

第一、robots.txt文件对网站有什么好处

1、快速添加网站权重和访问量;

2、阻遏某些文件被查找引擎索引,可以节省服务器带宽和网站访问速度;

3、为查找引擎供应一个简洁明了的索引环境

第二、robots.txt文件放在哪里?

robots.txt文件应该放置在网站根目录下。举例来说,当spider访问一个网站(比如 http://www.******.cn)时,首先会检查该网站中是否存在http://www.******.cn/robots.txt这个文件,如果 Spider找到这个文件,它就会根据这个文件的内容,来确定它访问权限的范围。

第三、robots.txt文件的格式

"robots.txt"文件包含一条或更多的记录,这些记录通过空行分开(以CR,CR/NL, or NL作为结束符),每一条记录的格式如下所示:":"

在该文件中可以使用#进行注解,具体使用方法和UNIX中的惯例一样。该文件中的记录通常以一行或多行User-agent开始,后面加上若干Disallow和Allow行,详细情况如下:

User-agent:

该项的值用于描述搜索引擎robot的名字。在"robots.txt"文件中,如果有多条User-agent记录说明有多个robot会受 到"robots.txt"的限制,对该文件来说,至少要有一条User-agent记录。如果该项的值设为*,则对任何robot均有效, 在"robots.txt"文件中,"User-agent:*"这样的记录只能有一条。如果在"robots.txt"文件中,加入"User- agent:SomeBot"和若干Disallow、Allow行,那么名为"SomeBot"只受到"User-agent:SomeBot"后面的 Disallow和Allow行的限制。

Disallow:

该项的值用于描述不希望被访问的一组URL,这个值可以是一条完整的路径,也可以是路径的非空前缀,以Disallow项的值开头的URL不会被 robot访问。例如"Disallow:/help"禁止robot访问/help.html、/helpabc.html、/help /index.html,而"Disallow:/help/"则允许robot访问/help.html、/helpabc.html,不能访问 /help/index.html。"Disallow:"说明允许robot访问该网站的所有url,在"/robots.txt"文件中,至少要有一 条Disallow记录。如果"/robots.txt"不存在或者为空文件,则对于所有的搜索引擎robot,该网站都是开放的。

Allow:

该项的值用于描述希望被访问的一组URL,与Disallow项相似,这个值可以是一条完整的路径,也可以是路径的前缀,以Allow项的值开头的URL 是允许robot访问的。例如"Allow:/hibaidu"允许robot访问/hibaidu.htm、/hibaiducom.html、 /hibaidu/com.html。一个网站的所有URL默认是Allow的,所以Allow通常与Disallow搭配使用,实现允许访问一部分网页 同时禁止访问其它所有URL的功能。

使用"*"and"$":

Baiduspider支持使用通配符"*"和"$"来模糊匹配url。

"$" 匹配行结束符。

"*" 匹配0或多个任意字符。

注:我们会严格遵守robots的相关协议,请注意区分您不想被抓取或收录的目录的大小写,我们会对robots中所写的文件和您不想被抓取和收录的目录做精确匹配,否则robots协议无法生效。

第四、使用robots.txt需要注意的几点地方:

1、指令区分大小写,忽略未知指令,下图是本博客的robots.txt文件在Google管理员工具里的测试结果;

2、每一行代表一个指令,空白和隔行会被忽略;

3、“#”号后的字符参数会被忽略;

4、有独立User-agent的规则,会排除在通配“*”User agent的规则之外;

5、可以写入sitemap文件的链接,方便搜索引擎蜘蛛爬行整站内容。

6、尽量少用Allow指令,因为不同的搜索引擎对不同位置的Allow指令会有不同看待。